RégressionsParameter – Wikipedia

Régressionsparamètre , aussi Coefficient de régression ou Poids de régression Nommé, mesurez l’influence d’une variable dans une équation de régression. [d’abord] À l’aide de l’analyse de régression, la contribution d’une variable indépendante (du régresseur) peut être dérivée du pronostic des variables dépendantes.

Dans le cas de la régression multiple, il peut être logique de considérer les coefficients de régression standardisés afin de pouvoir comparer les contributions explicatives ou prévisionnelles des variables indépendantes individuelles (quelles que soient les unités sélectionnées lors de la mesure des variables), par exemple B. pour voir quel régresseur apporte la plus grande contribution aux prévisions de variables dépendantes.

Le modèle linéaire multiple est donné

- ou en notation matricielle .

Le paramètre

est dénommé Paramètre de niveau , Section axe , Absolument , Constante de régression ou court En permanence (Engl. intercepter ).

Les paramètres

est appelé Paramètre d’escalade , Coefficient enrobage , ou augmenter (Engl. pente ).

Le

sont des variables d’interférence.

Les cas suivants sont différenciés lors de l’interprétation des coefficients de régression:

Transformation au niveau [ Modifier | Modifier le texte source ]]

Dans le cas où la variable endogène n’est pas transformée (niveau) et la variable exogène (niveau) s’applique également sur la base de

- .

Cela s’applique au niveau et aux paramètres d’inclinaison:

et

- , le reste des pairs (C.P.)

Le paramètre de niveau peut être interprété comme suit: La taille cible

Est en moyenne

(ou.

) Si tous les régresseurs

sont .

Pour le paramètre de pente respectif

est applicable: Augmentation

C.P. autour d’une unité, puis se lève

en moyenne

-Unités .

Transformation log-log [ Modifier | Modifier le texte source ]]

Dans le cas où la variable endogène transformée logarithmique (log) et la variable exogène (log) s’applique également

- , le reste des pairs (C.P.)

Cela peut être interprété comme suit: Les augmentations transformées

C.P. par 1%, puis la transformée augmente

en moyenne

-Pour cent . Sur le plan économique, cela correspondrait à l’interprétation comme une élasticité.

Le Coefficients de régression standardisés

(Parfois également appelé valeurs bêta ou poids bêta) résultant d’une régression linéaire dans laquelle les variables indépendantes et dépendantes ont été standardisées, c’est-à-dire que la valeur de l’attente était nulle et la variance a été définie. Ils peuvent également être calculés directement à partir des coefficients de régression de la régression linéaire:

Sont les variables explicatives standardisées

Indépendant et indépendant de la striction

(Condition préalable dans le modèle de régression classique), alors s’applique

Cela signifie que la somme des coefficients de régression standardisée des carrés est inférieure à un. Si un ou plusieurs des coefficients de régression standardisés sont supérieurs à un ou moins que moins, cela indique la multicolinéarité.

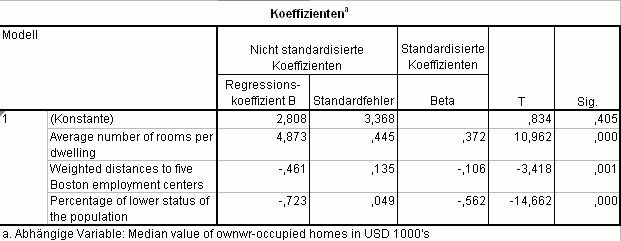

Pour la variable dépendante Prix des maisons moyennes dans les maisons auto-infirmières par district (En 1000 US $) à partir de l’enregistrement des données sur le logement de Boston, le modèle de régression Résultats adjacents:

- Chaque pièce de la maison augmente également le prix d’achat de 4873 $,

- Chaque kilomètre de plus à un lieu de travail réduit le prix d’achat de 461 $ et

- Chaque point de pourcentage de plus dans la part de la population de classe inférieure réduit le prix d’achat de 723 $.

Si vous normalisez toutes les variables, vous pouvez estimer l’influence d’une variable explicative sur la variable dépendante:

- La variable a la plus grande influence Proportion de la population de classe inférieure : −0,562,

- La variable a la deuxième plus grande influence Nombre de chambres : 0,372 et

- variable de mort Distance des lieux de travail A la moindre influence: −0,106.

Si les variables étaient indépendantes les unes des autres, la proportion de la variance déclarée pourrait être spécifiée sur la base des coefficients de régression au carré:

- Variable de mort Proportion de la population de classe inférieure explique près de 32% de la variance du prix des maisons intermédiaires ( ),

- variable de mort Nombre de chambres explique près de 14% de la variance du prix des maisons intermédiaires ( ) et

- variable de mort Distance des lieux de travail explique un peu plus de 1% de la variance du prix des maisons intermédiaires ( ).

- Jürgen Bortz, Christof Schuster: Statistiques pour les sciences humaines et sociales . 7., édition entièrement révisée et élargie. Springer, Berlin 2010, ISBN 978-3-642-12769-4.

- ↑ Bortz, Schuster: Statistiques pour les sciences humaines et sociales. Springer-Verlag Berlin Heidelberg New York 2010. ISBN 978-3-642-12769-4, S. 342 ff.

est dénommé Paramètre de niveau , Section axe , Absolument , Constante de régression ou court En permanence (Engl. intercepter ).

est dénommé Paramètre de niveau , Section axe , Absolument , Constante de régression ou court En permanence (Engl. intercepter ).  est appelé Paramètre d’escalade , Coefficient enrobage , ou augmenter (Engl. pente ).

est appelé Paramètre d’escalade , Coefficient enrobage , ou augmenter (Engl. pente ).  sont des variables d’interférence.

sont des variables d’interférence.

Est en moyenne

Est en moyenne  ) Si tous les régresseurs

) Si tous les régresseurs  sont .

sont .  est applicable: Augmentation

est applicable: Augmentation  C.P. autour d’une unité, puis se lève

C.P. autour d’une unité, puis se lève  en moyenne

en moyenne

Indépendant et indépendant de la striction

Indépendant et indépendant de la striction  (Condition préalable dans le modèle de régression classique), alors s’applique

(Condition préalable dans le modèle de régression classique), alors s’applique

Recent Comments